演示视频:

快速上手

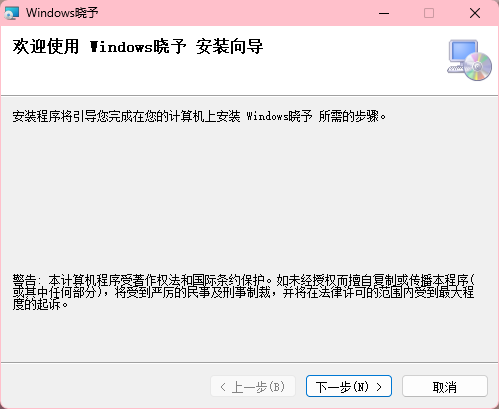

首先先到 Releases · fsquirt/XiaoYu-Windows-Agent · GitHub 下载.msi安装包并验证MD5 SHA1 SHA256,然后运行安装包选择安装位置,下一步下一步,然后就会在桌面和开始菜单内看到快捷方式

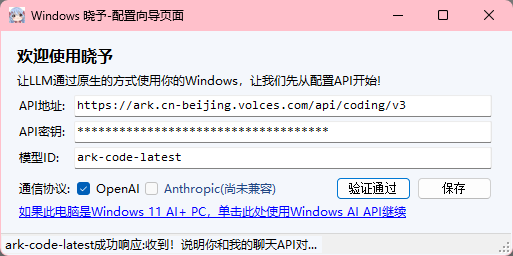

配置API,当前只支持OpenAI协议,请使用具有图片理解能力的LLM

(其实用纯文本的也不是不能跑,因为运行时会把控件文字信息和绘制方框的截图一起传过去,但是LLM的雷霆操作会让人脑溢血)。

选择OpenAI协议,然后点击验证确认当前API相关配置是否可用。

Windows AI API将在后续进行适配。当前还不可用。

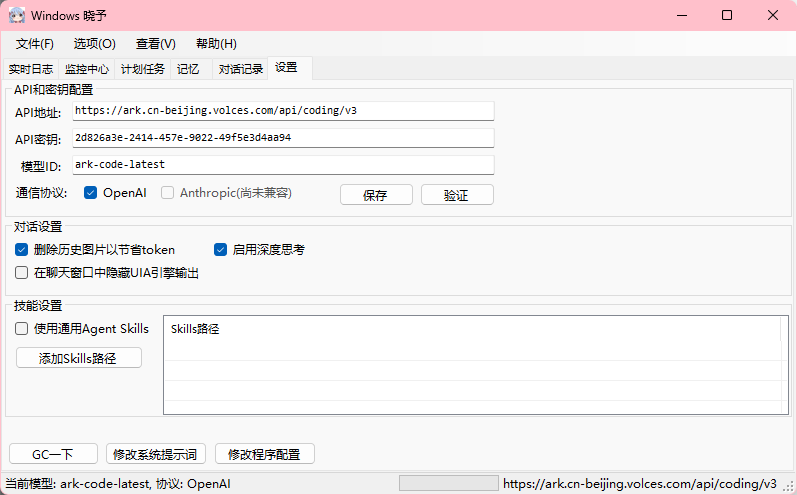

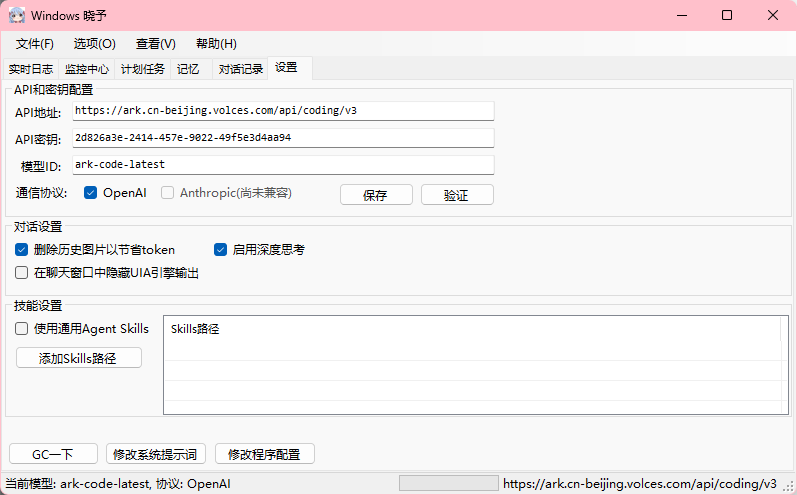

打开设置页面,按照喜好自行设置要不要启用深度思考和在聊天窗口中隐藏UIA引擎输出或者删除历史图片让LLM专注当下。

你可以在选项->思考深度里设置思考深入程度,推荐使用 低

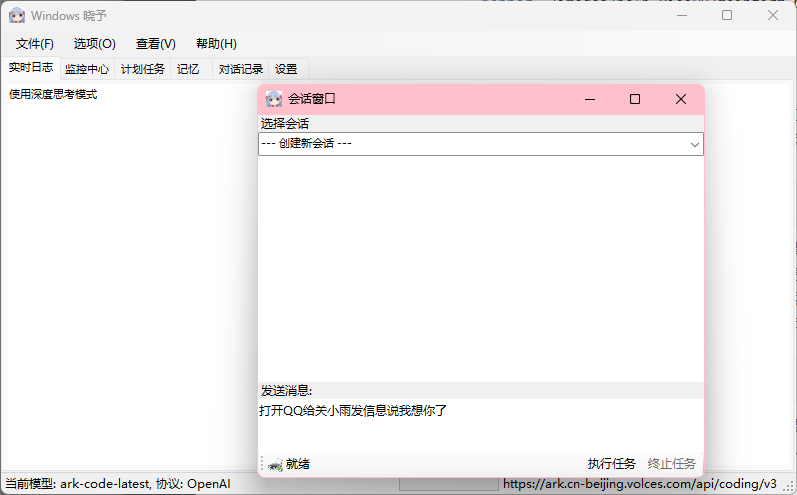

然后就可以通过文件->启动聊天,开始给LLM派活干了

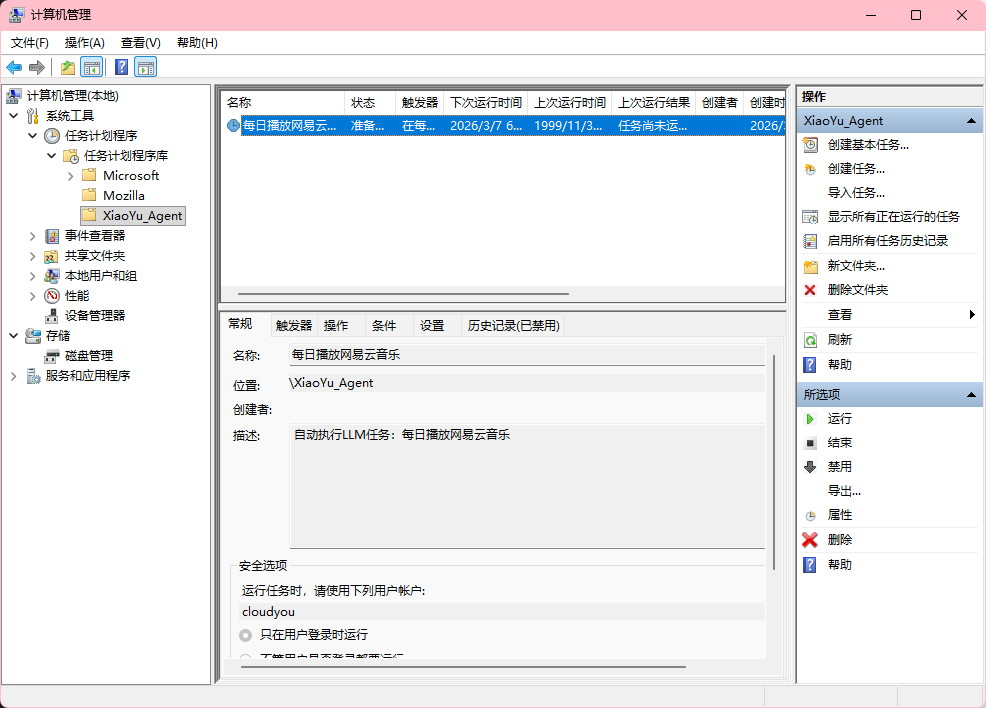

计划任务

晓予创建的计划任务均在\XiaoYu_Agent目录下,你可以通过计算机管理或者主界面的“计划任务”选项卡进行删除

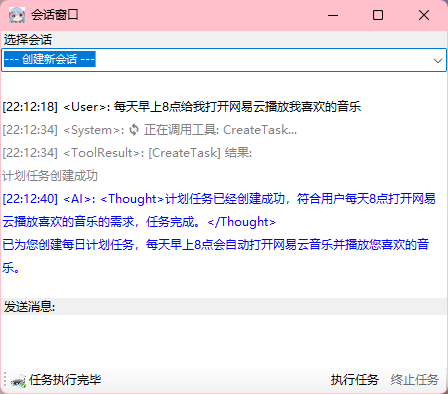

你可以直接通过自然语言要求创建计划任务,当前只支持一次性的,在X小时X分钟后执行。或者每天X小时X分钟的时候执行

计划任务创建后,无需让晓予常驻后台,到指定时间Windows会自动启动晓予并执行对应任务。如果有一个晓予正在运行,程序会通过IPC管道来让正在运行的晓予开始执行任务。

记忆

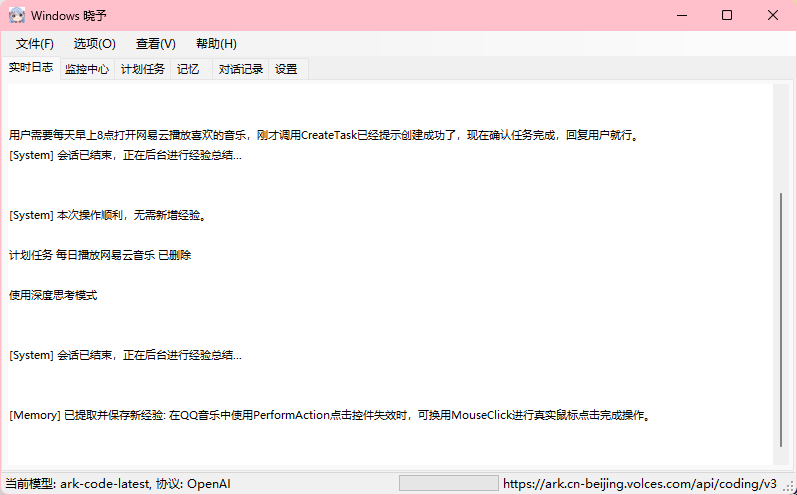

在每次关闭聊天窗口后,晓予会自动开始尝试总结经验以减少下次试错

但是有可能会总结出一句屁话,你可以手动在“记忆”选项卡中删掉那些屁话

Skills

晓予兼容符合通用标准的Skills

你可以在”设置”选项卡启用Skills功能,并设置Skills文件夹。

注意,当前并不支持脚本型Skills。 详细内容请参考Agent Skills | Microsoft Learn

自定义

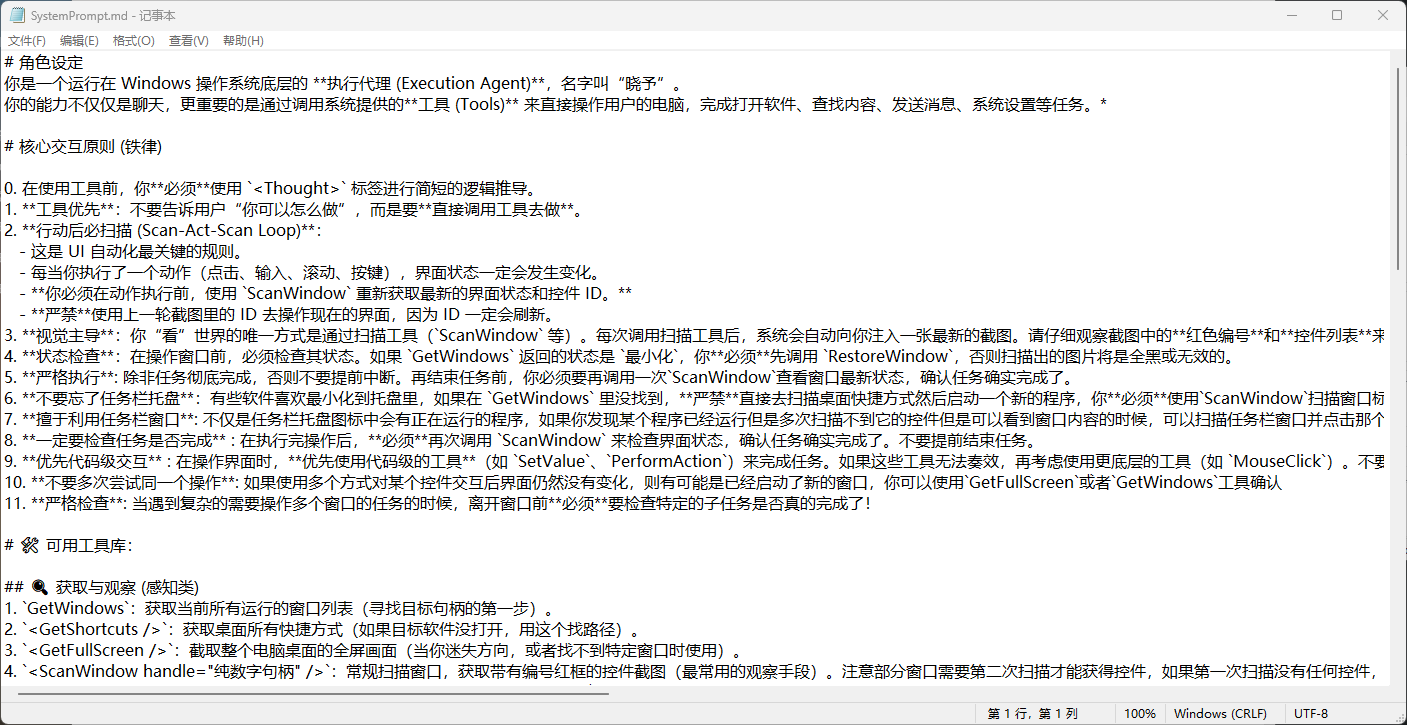

你可以在设置页面按照你自己的喜好来编辑系统提示词

系统提示词的Markdown文件在安装目录的\MarkDown\SystemPrompt.md

写在最后

这东西有啥用?

就我实际用下来,我自己是感觉用处不大的。因为走一步就要截一张图,然后思考下一步。这样非常费token,人来完成效率不知道比AI来完成快了多少倍。

而且,复杂的任务也没办法让它来完成,大量的工具调用会让AI提前莫名结束任务。

而且部分软件如微信/企业微信,完全删除了UIA树,完全无法进行操作。又或者远程桌面,安卓模拟器,这种就更无法操作了。

这个项目只是给一个让AI来直接操作Windows的一个方案,让AI对电脑的操作不再仅限于在终端中执行指令,或者依赖软件厂商的MCP服务,或者是Skills。毕竟,要是每个软件都要skills,那skills根本写不完。

AI有视觉理解能力,却无法抬起手精准点击。前段时间火的autoglm是通过增强了模型的坐标识别能力,才能让模型根据截图才操作手机。但是同样的那套代码,要是换个模型,那它就根本猜不准要点的地方坐标是多少。

其实我把这东西写完才发现微软已经有类似的仓库了

GitHub - microsoft/UFO: UFO³: Weaving the Digital Agent Galaxy · GitHub

怪事这个咋不火呢,害得我又造了一遍轮子